Der heutige Freitag bot eine lustige Überraschung: Plötzlich konnten von keinem unserer Hosts aus mehr Mails an Adressen unter der Domain hotmail.com zugestellt werden. Gestern ging’s noch. Heute nicht mehr.

Ich empfehle jedem Kunden, der für eingehenden Mailverkehr gerne eine Blacklist einsetzen möchte, ausschließlich welche zu verwenden, die auch nachvollziehbar machen, warum jemand gelistet wird: Sprich, wo man eine Message-ID, eine Beispiel-Mail oder auch nur wenigstens einen Timestamp erfahren kann, nach dem man im Logfile suchen kann. Bei Hotmail gibt es so etwas nicht. Also, so überhaupt nicht. Man kann nichts nachschlagen; man bekommt nur einen Link auf eine Seite, die die Statuscodes erklärt und die einem „hilfreich“ mitteilt:

Die E-Mail wurde von Windows Live Hotmail wegen Verletzung der Richtlinien zurückgewiesen. Ursache für die Zurückweisung können Spam-verdächtige Inhalte oder die Zuverlässigkeit der IP-Adresse/Domäne sein. Wenn Sie kein E-Mail-/Netzwerkadministrator sind, wenden Sie sich an Ihren E-Mail-/Netzwerk-Dienstanbieter, um Unterstützung zu erhalten.

Darin war Microsoft ja immer schon groß: Jeden, der irgendwelche Probleme hat, an den Administrator zu verweisen – aber jenem dann nicht einen Deut Hilfestellung zu geben, was für Probleme man mit einem hat, denn als Administratoren der Mailserver sehen wir in unseren Logs keinen Deut mehr als das, was auch die Enduser in ihren Bouncemails sehen. Pickel bekomme ich auch immer dann, wenn ich als Grundlage für ein Blacklisting Phrasen wie „…könnte…“ oder ganz besonders „…oder…“ lese. Ja Himmel nochmal, die Sperrung ist doch nicht vom Himmel gefallen; die wird doch einen konkreten Grund haben – wieso nennt ihr dann nicht einfach den konkreten Grund, statt mit verschiedenen theoretischen Möglichkeiten absolut überhaupt nicht hilfreich zu sein?

Ich möchte kurz einwerfen, dass wir selbstverständlich eine strikte Anti-Spam-Politik fahren. Wir filtern selbst Spam aus, so gut es geht; wir betreiben natürlich keine offenen Relays; wir stopfen Sicherheitslücken in Webapplikationen, die einen Spamversand ermöglichen; wir verpflichten unsere Kunden, Mailings nur mit confirmed Opt-In zu betreiben; und sollte wirklich mal ein Kunde als Spammer auffallen, wird ihm auch tatsächlich gekündigt. Nicht ohne Grund findet man praktisch nie auch nur einen unserer Server auf irgendwelchen Blacklists, außer vielleicht mal temporär zwischen Feststellen und Behebens eines Problems. Insofern ist es schon verwunderlich, wenn Hotmail plötzlich Mails von Hosts abweist, die in den Augen der gesamten restlichen Welt absolut „sauber“ sind – immerhin gibt es genug Massen-RBL-Checker, bei denen wir problemlos verifizieren können, dass Hosts, von denen Hotmail nichts annehmen will, definitiv auf keiner Blacklist stehen.

Kommen wir also zum „was tun“, und da redirected Hotmail einen auf dieses hübsche Formular, das man bei Zustellungsproblemen bitte ausfüllen möge:

https://support.msn.com/eform.aspx?productKey=edfsmsbl&ct=eformts&st=1&wfxredirect=1

Da geht’s dann los:

- Primärer Kontaktname für das Unternehmen

- Primäre E-Mail-Adresse für das Unternehmen

- Aus welcher Domäne heraus senden Sie?

- Wie würden Sie Ihre Firma oder sich selbst beschreiben?

Gut, soweit noch nachvollziehbar und auch kein Problem – vor allem, da man sich beim letzten Punkt durchaus als „Internetdienstanbieter (ISP)“ oder „E-Mail-Dienstanbieter (ESP)“ klassifizieren kann. Das hat nur keinen Einfluss auf den Rest des Formulars, der wie folgt aussieht:

- Wie lauten die IP-Adressen Ihrer ausgehenden E-Mail-Server (aus der Perspektive des empfangenden Mailservers)?

- Handelt es sich bei Ihrem Server um einen dedizierten oder einen freigegebenen Server?

- Geben Sie bitte zur schnellen Lösung des Problems möglichst viele Details an, einschließlich des Datums und der Uhrzeit, zu denen das Problem auftrat, einer Beschreibung des Vorgangs, den Sie ausführen wollten, der genauen Schritte, durch die das Problem verursacht wurde, sowie detaillierter Informationen über möglicherweise zurückgegebene Fehlermeldungen.

- Kopieren Sie alle Fehlermeldungen, und fügen Sie sie ein:

- Welchen Internetdienstanbieter verwenden Sie?

- Welches Betriebssystem verwenden Sie?

- Nennen Sie Ihre E-Mail-Übertragungssoftware.

- Nennen Sie Ihre E-Mail-Listen-Verwaltungssoftware.

- Wie werden zurückgesendete Nachrichten (Unzustellbarkeitshinweise) von Ihrem System bearbeitet?

- Wie häufig senden Sie E-Mail?

- Welchen Umfang weisen diese E-Mail-Sendungen auf?

- Nennen Sie einige der Konten innerhalb der Systeme von Microsoft, an die Sie zu senden versucht haben.

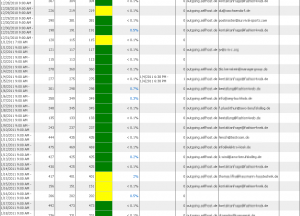

- Werden in Ihren SMTP-Protokollen fehlerhafte Transaktionen angezeigt, wenn Sie versuchen, E-Mails an Adressen bei MSN, Windows Live Hotmail oder andere MSN-Dienste zu senden? Wenn ja, fügen Sie diese Einträge hier ein.

- Können Sie von Ihren E-Mail-Servern eine Verbindung via Telnet mit Port 25 von „mx1.hotmail.com“ herstellen?

- Können Sie die Route zu 216.32.183.201 von Ihren E-Mail-Servern rückverfolgen?

- Geben Sie Beispiele einiger von Ihnen gesendeten Nachrichten einschließlich der Kopfzeilen an (aus der Perspektive der Empfänger). Kopieren Sie den Text und fügen Sie ihn hier ein.

- Auf welche Art werden Empfänger Ihren E-Mail-Listen hinzugefügt?

- Geben Sie die URL Ihrer Website an.

- Geben Sie die URL Ihrer Datenschutzrichtlinie an.

- Geben Sie die URL an, unter der sich Benutzer für den Empfang Ihrer E-Mails entscheiden können.

- Geben Sie die URL an, unter der sich Benutzer dauerhaft von Ihrer E-Mail-Liste streichen lassen können.

- Sind Sie derzeit Kunde von Return Path?

- Nehmen Sie am Sender Score Certified-Programm teil?

- Veröffentlichen Sie SPF (Sender Policy Framework)-/Sender-ID-Datensätze für Ihr IP?

- Verwenden Sie gesonderte IPs für Transaktionskommunikation im Gegensatz zu Werbe-/Abonnement-Marketingkommunikation?

- Nehmen Sie am Junk-Mail-Meldeprogramm (Junk Mail Reporting Partner Program, JMRPP) teil?

- Setzen Sie Smart Network Data Services ein?

Alle diese Fragen sind verpflichtend zu beantworten – dabei sind drei Viertel davon für uns als ISP überhaupt nicht sinnvoll beantwortbar: Welches Betriebssystem verwenden Sie? – Ja soll ich da alle Betriebssysteme aller Server aufführen?! Nennen Sie Ihre E-Mail-Übertragungssoftware – Äh, „verschiedene“?! Wie häufig senden Sie E-Mail? – Nun ja, hm, „sehr häufig, denn wir hosten ein paar tausend Domains“?! Geben Sie die URL an, unter der sich Benutzer für den Empfang Ihrer E-Mails entscheiden können – Nun, sagten wir bereits, dass wir ISP sind? Nicht wir verschicken diese Mails!

Besonders großartig finde ich persönlich die Aufforderung, einige Mails mit Headern und Inhalt in das Formular zu kopieren. Ist Microsoft sich im Klaren darüber, dass wir als ISP nach geltendem Datenschutzrecht überhaupt nicht berechtigt sind, die Kommunikation unserer Kunden einzusehen?

Der Witz schlechthin ist schließlich: Es ist auch nicht möglich, postmaster@hotmail.com oder abuse@hotmail.com zu erreichen – die SMTP-Verbindung wird nämlich bereits nach dem MAIL FROM: abgewiesen, nicht erst nach dem RCPT TO:. Ich bin mir nicht sicher, ob das noch als RFC-konform angesehen werden kann, denn eigentlich handelt es sich hierbei um Adressen, die verpflichtend bestehen und verpflichtend von administrativem Personal gelesen werden sollten.

Tja, was nun? Wir haben nun zunächst Hotmail über einen extern stehenden Relayserver mit der Bitte um Unterstützung angeschrieben. Aber im Grunde sind wir wütend: Besonders, weil Hotmail nun gerade einer der Mailprovider ist, die sich jahrelang einen feuchten Dreck um Spam-Prävention gekümmert haben und nun heute – ähnlich wie zum Beispiel auch AOL – weitestgehend nach Gutsherrenart und nicht nachvollziehbaren Kriterien Hosts blockieren und es selbst versierten und verantwortungsbewussten Postmastern extrem schwer machen, für Abhilfe zu sorgen.

Ganz ehrlich? Ginge es hier nur um mich persönlich und nicht um noch einen Haufen Kunden, würde ich angesichts dieses Verhaltens schlicht sagen: Wenn Hotmail keine Mails mehr von mir will, dann ist das eben so. Das sagt letzten Endes mehr über Hotmail als über mich.

So werde ich aber nun mal gleich wieder meinen Kollegen in seinem Bestreben nach Klärung und ggf. temporären Workarounds unterstützen … und hoffen, dass dieses Trauerspiel ein schnelles Ende findet.

Update

Wir routen alle Mails an Hotmail jetzt erstmal über einen unserer Server, der in einem externen Rechenzentrum in einem ganz anderen IP-Netz steht. Als Workaround tut das erstmal, bis Hotmail sich zu einer Stellungnahme bequemt.

Update 2

Ui, fantastisch: Wenn man sich bei Microsoft ein bisschen umschaut, kann man unter Umständen tatsächlich den in einer riesigen Textwüste versteckten Link „To learn more about the Sender and ISP Services, go here“ finden (kleiner Tipp an Microsoft: Vielleicht mal die Einführung zu Links bei SELFHTML nachlesen, die anschaulich erklärt, warum man Links nicht mit Wörtern wie „hier“ beschriften sollte). Die Zielseite des Links verweist dann schließlich auf die Smart Network Data Services von Microsoft, wo man die Reputation „seiner“ IP-Adressen einsehen kann – nachdem man sich als für die betreffenden Netzbereiche zuständig registriert hat.

Das funktioniert so, dass man dort einen Netzbereich eingibt und SNDS dann schaut, ob die Reverse Lookups der IPs aus diesem Netzbereich alle in der gleichen Domain liegen, dann sind postmaster@ und abuse@ unter dieser Domain autorisiert; zusätzlich wird das Whois abgegrast. SNDS erklärt auch den Algorithmus:

The WHOIS approach queries global, regional, and national IP registrars, such as ARIN and APNIC, using the first IP in the range to find the most specific allocation record covering it. It then looks to make sure the range being requested isn’t larger than the record covers. If so, it authorizes any email addresses contained in the record.

Das ist natürlich prima, denn in unseren Netzbereichen stehe ich natürlich mitsamt E-Mail-Adresse drin. Also flugs den Vorgang gestartet – daraufhin findest SNDS sage und schreibe zwanzig E-Mail-Adressen, die sich als für diesen Netzbereich zuständig erklären können, darunter einige Adressen von Plus.line, unserem Uplink-Provider (was ja völlig okay ist) sowie eine ganze Reihe weiterer E-Mail-Adressen von Domains, die definitiv nicht uns gehören, die nicht auf IPs in unserem Netzbereich verweisen und die sowieso schon mal überhaupt nicht in den Whois-Einträgen unserer Netzbereiche stehen. Nur eine E-Mail-Adresse fehlt in der Liste: Meine. Also, nur damit hier keine Missverständnisse entstehen:

$ whois 82.98.87.192

[Querying whois.ripe.net]

[...]

inetnum: 82.98.87.192 - 82.98.87.255

netname: JONASPASCHE-FFM-003

descr: Jonas Pasche

descr: Albert-Schweitzer-Strasse 2d, Mainz

country: DE

admin-c: JP55128-RIPE

tech-c: PLN

status: ASSIGNED PA

mnt-by: PLUSLINE-MNT

source: RIPE # Filtered

[...]

person: Jonas Pasche

address: Albert Schweizer Str. 2d

address: 55128 Mainz

phone: +49 6131 90667 27

fax-no: +49 6131 90667 28

e-mail: mail@jonaspasche.de

nic-hdl: JP55128-RIPE

mnt-by: HGC-MNT

source: RIPE # Filtered

[...]

Tja, soviel zur Auskunft, der Algorithmus „authorizes any email addresses contained in the record“ – schön wär’s. Netterweise bietet Microsoft die Möglichkeit, Probleme mit dem Algorithmus zu melden, aber nicht, ohne gleich anzumerken, dass er natürlich intensiv getestet wurde und dass das SNDS-Team auch so oder so keine manuellen Autorisierungen vornehmen kann:

Although this algorithm has undergone extensive testing, please report any issues, remembering of course to follow the feedback guidelines. Be aware that the SNDS team cannot manually adjust authorizations and will be unable to process any such requests.

Tja. Also hab ich dann mal ein Problem mit dem Algorithmus gemeldet. Und warte dann mal darauf, dass der Algorithmus in Ordnung gebracht wird, denn manuell wird ja nicht autorisiert. Damit ich dann, wenn ich mich möglicherweise irgendwann tatsächlich als für diesen Netzbereich zuständig autorisieren kann, zumindest einmal einsehen kann, was Hotmail möglicherweise gegen uns hat. Aber klar, mit einer Möglichkeit der Aufhebung der Sperrung ist das auch wiederum nicht verbunden, selbst wenn sich hierbei ein Problem zeigen sollte, das tatsächlich bei uns besteht und tatsächlich von uns behoben werden könnte. Insofern – warum mache ich mir die Mühe eigentlich …

Die Registrierung der Zuständigkeit für einzelne IP-Adressen aus unserem Netz ist übrigens kein Problem, sofern das Reverse Lookup irgendwie auf uns verweist, denn die postmaster– und abuse-Adressen betreuen wir bei unseren eigenen Domains ja durchaus selbst. Also habe ich mal zumindest einzelne IP-Adressen hinzugefügt. Ist es nicht beruhigend, dass SNDS freimütig zu allen manuell hinterlegten E-Mail-Adressen nur dieses hier zu sagen hat:

All of the specified IPs have normal status.

Nur ändert das leider nichts daran, dass weiterhin SMTP-Verbindungen auch von den IP-Adressen, von denen SNDS behauptet, sie hätten einen normalen Status, abgewiesen werden:

550 SC-001 Unfortunately, messages from $IP weren’t sent. Please contact your Internet service provider since part of their network is on our block list. You can also refer your provider to http://mail.live.com/mail/troubleshooting.aspx#errors.

Ein wenig fühlt es sich an, als wäre ich in der Twilight Zone. Hoffentlich hat das bald ein Ende. Wir bleiben dran.

Update 3

Ein Facepalm jagt den nächsten. Über unseren Umleitungs-Workaround haben wir es tatsächlich geschafft, eine Mail an abuse@hotmail.com abzusetzen. Prompt trudelt ein Autoresponder ein, der sich mit den Worten

We wanted to thank you and let you know that your report has been received.

freundlich bedankt und darauf hinweist:

Please don’t reply to this message, because it is from an unmonitored email address.

Die fragliche Mail kommt … auch von abuse@hotmail.com. Unmonitored, was?

Update 4

07.03.2011, 12:30 Uhr

Okay, bei postmaster@hotmail.com sieht’s noch schlimmer aus. Hier kommt dann postwendend ein Autoresponder mit der freundlichen Nachricht:

postmaster@hotmail.com is an unmonitored account. If you need assistance, please consult our help pages or visit http://postmaster.live.com.

Hierzu kann ich nur RFC 2821 zitieren:

Any system that includes an SMTP server supporting mail relaying or

delivery MUST support the reserved mailbox "postmaster" as a case-

insensitive local name. [...]

SMTP systems are expected to make every reasonable effort to accept

mail directed to Postmaster from any other system on the Internet.

In extreme cases --such as to contain a denial of service attack or

other breach of security-- an SMTP server may block mail directed to

Postmaster. However, such arrangements SHOULD be narrowly tailored

so as to avoid blocking messages which are not part of such attacks.

Interessant ist in diesem Zusammenhang auch die Listing-Policy für postmaster.rfc-ignorant.org, die es ausdrücklich als Grund für ein Blacklisting ansieht, wenn Mails an den Postmaster mit einem Autoresponder beantwortet werden, der zum Ausdruck bringt, dass die Mail nicht von einem Menschen gelesen wird:

Further, if a postmaster address contains a „redirecting auto-acknowledgement“, such that it is obvious that the message will not be received by a human (as specified in the RFCs), that shall also be considered a listable offense.

Ah, sehr schön: Sie nehmen das auch ernst und führen hotmail.com tatsächlich auf ihrer Blacklist.

Unnötig zu sagen, dass es bisher weder auf unsere Anfrage an abuse@hotmail.com von Freitag Nachmittag eine Antwort gab, noch auf unsere Anfrage, wieso der SNDS-Algorithmus zwar völlig Fremden erlaubt, Details zum Mailverkehr unserer Netze einzusehen, aber nicht uns, obwohl wir als admin-c eingetragen sind. Und ebenso unnötig zu sagen, dass für die IP-Adressen, die wir manuell autorisiert haben, auch weiterhin „All of the specified IPs have normal status“ angegeben wird. Die fragliche Seite trägt zwar den Hinweis „This data is updated once a day, not real-time so it may not reflect the current state of the system“, aber nachdem das Blacklisting nun schon stolze drei Tage andauert, kann man auch das nicht mehr als Ausrede gelten lassen.

Also, nur um das nochmal festzuhalten: Wir kriegen alle unsere Netze komplett gesperrt, ohne je auch nur eine Abuse-Message erhalten zu haben; wir können SNDS aufgrund eines Fehlers im Algorithmus nicht für unsere Netze nutzen; für einzelne IP-Adressen gibt SNDS faktisch falsche Auskünfte und disqualifiziert sich damit im Grunde; Hotmail erwartet, dass wir zum Debugging Datenschutzverletzungen mit Kundenmails begehen; es gibt keine RFC-konforme Postmaster-Adresse; Mails an abuse@hotmail.com werden nicht beantwortet; Mails an msn-snds@microsoft.com werden nicht beantwortet.

Well done, Microsoft.

Update 5

09.03.2011, 11:38 Uhr

Es ist ja nicht so, dass wir nicht zumindest versucht hätten, das absurd lange Beschwerdeformular nach bestem Wissen und Gewissen auszufüllen und alle Fragen höflichst zu beantworten; im schlechtesten Fall zumindest mit „Wir sind selbst ISP; Frage trifft nicht zu“. Nach dem Absenden haben wir eine Ticketnummer erhalten sowie den Hinweis:

Um sicherzustellen, dass Sie die Antwort von Microsoft erhalten, fügen Sie Ihrer „Sicherungsliste“ für E-Mails die Domäne „microsoft.com“ hinzu. Geht in Ihrem „Posteingang“ innerhalb von 24 Stunden keine Antwort ein, überprüfen Sie die Ordner „Massensendungen“ oder „Junk-E-Mail“.

Zunächst einmal: Ich habe zwar schon etliche Mailserver administriert, sendmail, qmail, postfix, exim … und habe aber dennoch keine Vorstellung, was Hotmail mit einer „Sicherungsliste“ meinen könnte. Offenbar eine Art Whitelist. Aber davon abgesehen:

Hände rauf, wer überrascht ist – die 24 Stunden sind mittlerweile lange um, und natürlich gab es keinerlei Reaktion von Hotmail. Das wirft dann nebenbei auch die Frage auf: Was bitte soll ich mit der Ticketnummer? Es gibt ja keine einzige andere Kontaktmöglichkeit – keine Postmaster-Adresse, keine allgemeine Support-Adresse, auch keine telefonische Hotline; man kann sich auf den Kopf stellen: Alles wird letztlich auf irgendwelche Formulare umgeleitet.

Ist das nicht der Witz schlechthin – mit einem der größten E-Mail-Provider weltweit … kann man nicht per E-Mail kommunizieren.

Sollte tatsächlich irgendwann mal doch noch eine Antwort auf unsere Beschwerde kommen, gehe ich jede Wette ein, dass der Absender vermutlich donotreply@hotmail.com heißen wird und sich in der Mail ein Hinweis finden wird, dass man nicht antworten kann, sondern bitte das Formular unter der folgenden URL ausfüllen möge … (Anekdote am Rande: Bei Ryanair ist das noch viel schlimmer. Dort gibt’s für Beschwerden nicht mal ein Online-Formular. Man muss sich per Fax beschweren, an eine Faxnummer in Irland. Und dabei … eine E-Mail-Adresse angeben. Die Antwort von Ryanair folgt dann per E-Mail – von einer Adresse aus, an die man nicht antworten kann, und mit dem Hinweis, dass, wenn man noch etwas antworten möchte, die E-Mail bitte ausdrucken und zusammen mit seiner Antwort wieder nach Irland faxen möge.)

Wir haben nun erstmal das Beschwerdeformular ein weiteres Mal ausgefüllt, ebenso gewissenhaft, diesmal auf Englisch (das Formular ist auf Deutsch, deshalb hatten wir es beim ersten Versuch auch auf Deutsch ausgefüllt). Und haben dabei auch mal die Ticketnummer erwähnt, die wir bereits erhalten haben. Die Hoffnung stirbt ja bekanntlich zuletzt.

Update 6

10.03.2011, 14:40 Uhr

Holy crap! Wir sind noch zurückhaltend mit Luftsprüngen, aber nachdem wir es jetzt von einigen Hosts aus getestet haben, macht es ganz den Eindruck, als sei die Sperrung aufgehoben. Zurückhaltend sind wir vor allem deshalb, weil wir auch weiterhin (auch über 24 Stunden nach dem zweiten Ausfüllen des Formulars) keinerlei Rückmeldung erhalten haben, also auch nicht unter der von uns extra dafür angelegten Hotmail-Adresse. Wir wissen also nicht nur nicht, warum wir eigentlich gesperrt worden sind; wir wissen auch nicht, warum es jetzt wieder geht – ob da jemand tatsächlich unsere Anfrage gelesen und bearbeitet hat oder ob das alles nur ein bedauerliches Missverständnis war, oder ob schlicht die Sperrung automatisiert nach einer definierten Zeit zurückgenommen wurde und jederzeit wieder erfolgen kann.

Was auch weiterhin nicht funktioniert, ist eine Authentifizierung für unsere IP-Netze bei SNDS (und wer nicht das ganze Blog liest, sondern nur dieses eine Posting hier, möchte vielleicht einen kurzen Blick auf SNDS werfen). Da werden wir gegenüber Hotmail noch dranbleiben müssen.

Für heute können wir uns jetzt aber erstmal einen Moment zurücklehnen und uns den Schweiß von der Stirn wischen … waren ja nur sechs Tage, die Hotmail begründungslos den Mailverkehr aller unserer Kunden abgeklemmt hat.